为什么我不是一个狂热的AI信徒

当OpenClaw的风潮席卷全球,甚至当一些地方政府都推出了针对OpenClaw的支持性措施时,大众不可避免的陷入新一轮的情绪高潮,一部分人在狂欢,更多的人在焦虑和恐慌。

前言

早在四五年前,伴随着以Chat GPT为首的法学硕士大语言模型(LLM)的问世,AI 就迅速确立了其在科技圈的绝对新宠地位。彼时,大众对AI的认知往往伴随着幻觉和逻辑断片的标签。大家心知肚明:AI瞬间生成的漂亮文本或许能作为灵感参考或初版草稿。但鲜有人敢将这些法学硕士视作真正严肃、可闭环交付的生产力工具。

但伴随着一众智能体(Agents)——特别是像OpenClaw这类可以直接操作电脑并进行复杂任务规划的工具出现——正在将AI的应用场景从APP里的对话框,程序员的IDE和视觉创作者的ComfyUI,推向更广泛的通用任务领域。

卖工具的人

在这个技术突进的浪潮中,一个古老的商业定律再次应验:在淘金热里,最赚钱的永远不是那些苦哈哈挖金子的人,而是卖铲子和牛仔裤的商人。

在各大卖课机构、知识付费社群和各路自媒体营销号的疯狂渲染下,一场人为制造的技术焦虑开始在全网蔓延。连智能体(Agents)和大模型底座(Model)都分不清的大众在“再不用 AI 就晚了”和“OpenClaw 将淘汰 90% 的白领”的恐吓之下,乖乖的从兜里掏出钱来,只为了登上一个虚构的诺亚方舟。

当Meta的安全总监在电脑前因为OpenClaw删除掉了她的全部邮件而发出惊呼的时候,另一拨人正在付费安装一个带部署教程的开源项目。AI和它的衍生品就这样以一种前所未有的速度冲进每一个人的生活。比起技术普惠,更贴切的叫法应该是认知套利割韭菜。

壮丽的空洞

在这场由资本、营销号和自媒体共同主导的狂欢背后,真正支撑起大众盲目信仰的,是当前一代大模型在表达能力上展现出的极度欺骗性。当机器能够用极其流利、甚至带有情绪色彩的自然语言与我们对话,并在屏幕上自动执行复杂的键鼠操作时,人类会共情,将其拟人化,赋予其实际上并不具备的智慧、逻辑与意识。

这种拟人化带来的认知错位,正是迷失的起点。剥开智能体花哨的外衣,如果我们去审视其底层的运转逻辑,就会发现这并非一场真正意义上的认知革命,更像是一场巨大的统计学幻觉。

今年3月份的时候我有幸参加了一个由Akamai的CTO Robert Blumofe主讲的讲座,期间Robert提到了一个非常有趣的说法:

They are awesome because they are awesome.

如果要找个中文翻译,那大概可以是虚假的繁荣或者说壮丽的空洞。

需要明确区分的是:语言模型的幻觉与Agent系统的不可靠性是两种不同层面的风险。前者是概率采样的噪声,后者则是工具链组合、长链条推理中的系统性风险。但二者共享同一个底层困境:这一代AI的能力并非源于对现实世界的因果理解,而是一个庞大的概率论游戏。

如果你问一个LLM:天空的颜色是什么

AI会告诉你天空是蓝色的也有可能是灰蒙蒙的,这很符合我们的认知。但AI能够给出这个答案,绝不是因为它具备基础的物理学常识,懂得太阳光穿过地球大气层时会发生瑞利散射,导致波长较短的蓝光被广泛散射在天空中。也从未像人类一样在晴朗午后用视觉神经感受过那抹蔚蓝。

它之所以填上“蓝色”,仅仅是因为在它吞噬的数以万亿计的互联网人类语料库中,“天空”与“蓝色”这两个词汇的词向量距离最近。在它那冷冰冰的数学模型中,条件概率

“随机鹦鹉”是在机器学习中一个理论的比喻,指大型语言模型虽然能够生成合理的文句,但其实不能理解所处理的语句。它由艾米丽·本德、蒂默妮特·格伯鲁、安杰利娜·麦克米伦-梅杰和玛格丽特·米切尔(以Shmargaret Shmitchell名义)在2021年人工智能研究论文《论随机鹦鹉的危害:语言模型太大有坏处吗?🦜》中提出。

以上内容引用自维基百科;有关论文请参阅论随机鹦鹉的危害:语言模型太大有坏处吗?🦜

一个有趣的数据是,牛津英语词典收录词语约60万条,即便算上专有名词,乐观估计在百万量级。而大模型呢?主流大模型的激活参数早就已经到了十亿这个数量级,Kimi-K2.5更是直接说他们的总参数有一万亿。也难怪有笑话说,AI砍掉了亚马逊雨林里的一棵树,只是为了向你说一句:“我在”。

诚然,AI模型的性能从初代ChatGPT到现在的ChatGPT5、Gemini 3 Pro已经有了翻天覆地的变化。但是这些进步并非来源于底层技术的突破,主流模型都还在共享着Transformer这个基础架构。厂商们用更大的数据规模、更长的上下文窗口、更精细的人类反馈训练以及推理时的计算量分配策略取得了卓越的工程进步。但现在高质量、可合规获取的语料已经快要被各大AI厂商和数据底座挖掘一空。我们已经迎来了花两倍的算力不再能换来两倍的能力提升的时代。在底层架构没有范式突破、理论理解仍然缺位的情况下,把当前的进步速度线性外推到未来,是一种经不起审视的归纳谬误。

算法上的平庸之恶

哲学家汉娜·阿伦特(Hannah Arendt)在观察纳粹战犯时提出了平庸之恶的理论,即最大的邪恶往往不是来源于反社会的恶魔,而是来源于那些放弃了个人独立思考、在官僚系统中盲目服从规则的普通人。

如果说阿伦特揭示的“平庸之恶”源于人放弃思考,那么AI时代的新风险是人类主动将思考外包给不具备思考能力的机器。这种双重缺席——人不再思考,机器从未思考——构成了算法上的平庸之恶。

大模型本质上是对海量历史数据的概率拟合,它的输出天生就会向着统计学上的平均值和主流观点坍缩。它会抹平所有尖锐的、边缘的、极具个性的深刻见解,只输出那些看起来最安全、最符合大众预期的正确废话。AI 给出的答案往往伴随着完美的语法、极其严密的排版格式(比如经典的总分总结构加小标题),这种一本正经的呈现方式极具欺骗性,赋予了它一种虚妄的客观性和权威感。人们越来越懒得去交叉验证信息,懒得去忍受深度思考带来的脑力阵痛。当遇到问题时,第一反应不再是我该怎么去分析它,而是我该怎么写一段Prompt去问它。人类作为主体定义问题和逻辑思辨的核心能力正在被不可逆转地外包和退化。

而这种平庸化的影响远不止于人类自身。当AI生成的内容涌入互联网后,这些内容又再次被模型厂商抓取、清洗、喂回下一代模型的训练语料库。大模型的输出天然向着统计均值坍缩——它给出的永远是最安全、最主流、最不出错的那个答案。当这些被抹平了棱角的输出又变成下一代模型的食粮,下一代模型的输出会比上一代更加平庸,然后再次回流,周而复始。学术界已经开始用模型坍缩(Model Collapse)来描述这个现象:模型训练模型生成的数据,多样性和信息密度逐代衰减,最终收敛到一个毫无营养的统计噪声。

未来在哪里?

我们距离L3级别的AI还有多远

在自动驾驶领域,人们把自动驾驶分为六个级别:

- L0:自动驾驶功能仅在特定情况下介入,典型应用包括主动刹车和车道偏离警告

- L1:自动驾驶承担一定的辅助功能,例如自适应巡航和车道保持

- L2:需要驾驶员时刻监控并准备接管的自动驾驶

- L3:允许驾驶员在满足一定条件的情况下不再监控自动驾驶的运行

- ……

悲观地讲,无论算力如何发展,只要依然基于概率采样生成,这一代AI在数学上就无法实现100%的可靠性保证——而L3要求的,恰恰是形式化验证级别的确定性。

不妨做个思想实验:在一个不容许错误的决策链中,假设存在一个理想模型,每一步选择绝对正确的概率高达

我们无法在数学上严格证明这一代概率论底座的AI不会出错,但是却可以轻易地在数学上严格证明,只要它依然依赖概率采样生成,这一代AI是一定会出错的。错误不是是否会发生的问题,而是何时发生的问题。

在L2的时代,这种错误被我们宽容地称为“幻觉”,大不了人工排查,手动修改几行代码或是重写一段文案。但如果要跨越到L3,让AI真正脱离人类监控去接管核心业务闭环,这种根植于算法底层的、无法被彻底抹除的不可靠,就成了一颗随时会引爆的定时炸弹。没有哪家成熟企业,敢把核心身家押注在一个数学上已被证明不可靠的系统上。

有罪推定

在回答如何与AI共生之前,我们不妨会看看一个一个已经与复杂自动化设备生死博弈了半个多世纪的领域——航空业。

航空业从上世纪70年代开始引入自动驾驶。从最初依赖飞行员设定固定参数,到2019年空客A350-1000完成自动起飞演示,如今的自动驾驶理论上已具备从起飞到落地的全段能力。但飞行员并未被赶出驾驶舱。

时至今日,各民航当局都会要求飞行过程中任意时刻驾驶舱内不得少于2人。除了防范类似德国之翼的自杀事件之外,更多的是航空业在基于一种有罪推定来设计程序。

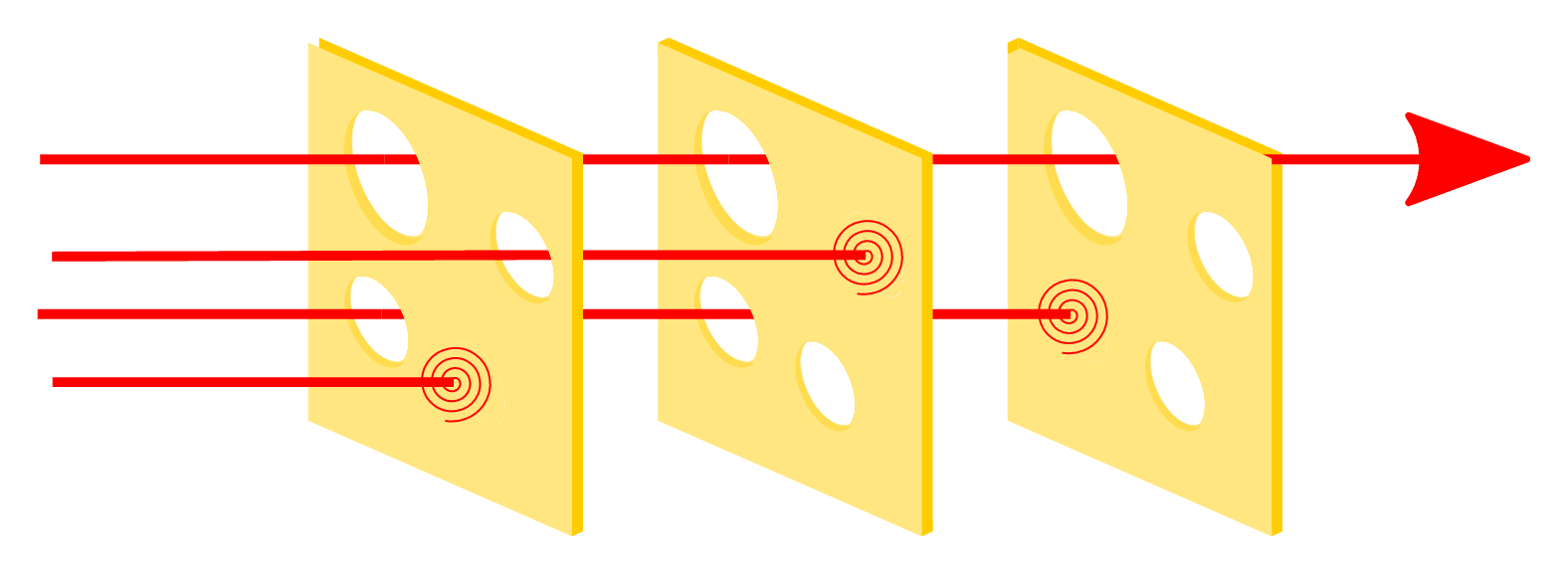

航空业有著名的瑞士奶酪模型:传感器、电脑、机械装置、人类——我们假定每个环节都不可靠,都会在任意时刻失效(奶酪上的洞)。通过设置备份、冗余和多层交叉验证,我们从架构设计上确保各层的洞不要对齐,从而避免风险击穿。

除了在架构设计的时候就假定每一层不可靠,航空业还用模拟机复训对抗自动化带来的技能退化。每年,每个飞行员都要进行模拟机复训,在模拟机上飞行员要面对的不是日复一日的正常航班,而是各种故障,从单发失效到空速不可靠(传闻国内有航司出过单发失效+高度不可靠+天气的组合故障)。在那个也许终其一生可能都不会碰到的情况里,飞行员被高压情景逼迫着榨干最后一丝认知资源,逼迫他们在剥离一切自动化辅助后,依然可以依靠自身能力把飞机安全的带回地面。

尾声:人机耦合的未来

我不是激进的保守派。无论我如何评价这一代AI,都无法改变它已深刻融入生活的事实。问题在于:在注定离不开AI的21世纪中后期,我们究竟要如何与之共生?

答案或许藏在航空业的实践中。现代飞行员既是操控者也是系统管理者,他们知道应该何时使用自动驾驶,何时必须人工接管,以及如何在模拟机里训练自己的手动飞行能力——即不依赖AI的原始逻辑推演与价值判断

我们希望AI替我们一键完成枯燥的周报,却不希望接待自己的是一个只会给AI喂提示词的医生;我们期待AI自动处理数据,却不敢坐进没有人类飞行员的飞机。

在概率的牢笼被打破之前,多给自己安排几次“模拟机复训”,也许是我能想到的最有效的对抗方法。

为什么我不是一个狂热的AI信徒